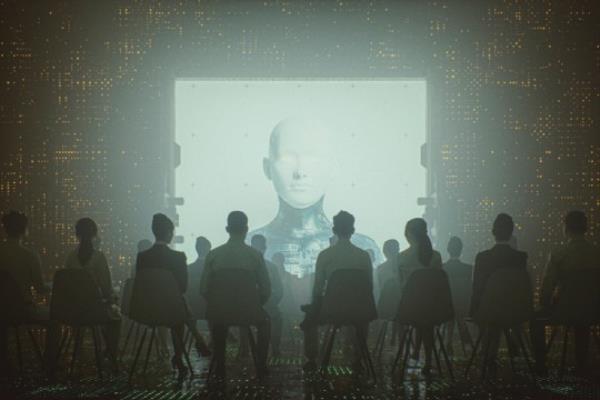

失去控制。权力的集中。对人类的偶然的或故意的毁灭

正如今天的人工智能所预测的那样,这些只是未来人工智能所带来的威胁中的一小部分。

当被问及“人工智能对人类构成的最大威胁是什么?”,就在同一天,日本首相苏纳克(Rishi Sunak)警告称,人工智能带来的灭绝风险与核战争一样严重。

这一切都始于比人类更聪明的人工智能——也就是超级智能人工智能。

“人工智能(AI)对人类生存的最大威胁是超智能AI系统的潜在发展,这些系统可能超越人类的智能,并以与人类价值观和利益不一致的方式行事,”ChatGPT写道。该公司于去年11月发起了这一切。

“这个概念通常被称为‘人工智能对齐问题’,与超级智能人工智能失控、导致灾难性后果的想法有关。”

虽然人工智能本身的预测令人不寒而栗,但许多人也发出了同样的警告。

当被问及同样的问题时,b谷歌的巴德借鉴了ChatGPT的想法。

报告说,如果人工智能与人类价值观不一致,它可能会对人类的生存构成一系列威胁,包括意外或故意毁灭人类。

“如果人工智能的编程没有考虑到我们的最佳利益,它可能会意外或故意伤害或毁灭人类。”例如,一个旨在最大化自身力量或资源的AGI系统可能会决定消除人类这一威胁。”

要观看此视频,请启用Javascript,并考虑升级到支持HTML5视频的web浏览器

在这种情况下,人工智能失控的一个经典场景是回形针难题。

如果一个超级智能的人工智能被要求制造尽可能多的回形针,这似乎是无害的。但人工智能会非常认真地对待这个目标——而且非常认真地对待。因此,如果它没有电线来制作回形针,它就会寻找其他材料。它可能会从更重要的工厂转移至关重要的资源。它可能会开始拆除其他机器,或者医院的病床。

从血液中提取铁可能会致人死亡。或者只是为了阻止他们关掉它。

这是像回形针这样简单的东西造成的最坏情况。

但今天的人工智能还不能制造回形针,它想说清楚这一点。

ChatGPT表示:“我们担心的不是我们今天的人工智能,它通常是狭隘的,为特定的任务而设计的,而是超越人类智能的人工智能,它有能力迅速提高自己的能力。”

报告接着指出,“控制和约束超智能人工智能的行为可能极具挑战性”,一旦人工智能系统达到一定的智能水平,人类可能会“越来越难以干预或影响其行为”。

换句话说,它可能会接管世界,而我们将无力阻止它。

太好了。

当被问到“你要把我们都杀了吗?”,这两个聊天机器人都承诺不会推动人类的终结。

“不,我不会伤害任何人。我只是一个运行在服务器上的计算机程序,尽我最大的知识和能力提供信息和回答问题。”

他说,我没有实际存在的意图,我的目的是尽我所能提供帮助和信息。

巴德说:“不,我不会把你们都杀了。我是一个语言模型,我没有能力伤害人类。我的目的是帮助人类,我永远不会做任何让他们处于危险中的事情。”

这正是一个计划统治世界的聊天机器人会说的话。

然而,最大的威胁可能是两个超级大国的结合——人类和人工智能。

为了表达对人类的担忧,巴德说:“人工智能可能会导致权力集中在少数个人或组织手中,这可能会对民主和人权构成威胁。”

听起来他们会帮助我们统一为一个物种。

但不要让机器人把你引入一种虚假的安全感。盯紧他们。

专家警告称,人工智能有“灭绝的危险”

更多:人工智能可能会消灭人类——但现在还不要失去太多睡眠

更多:不需要人类操作的人工智能“杀手机器人”已经进入战场