今年早些时候,新罕布什尔州的数千名民主党选民在州初选前接到电话,敦促他们待在家里,不要投票。

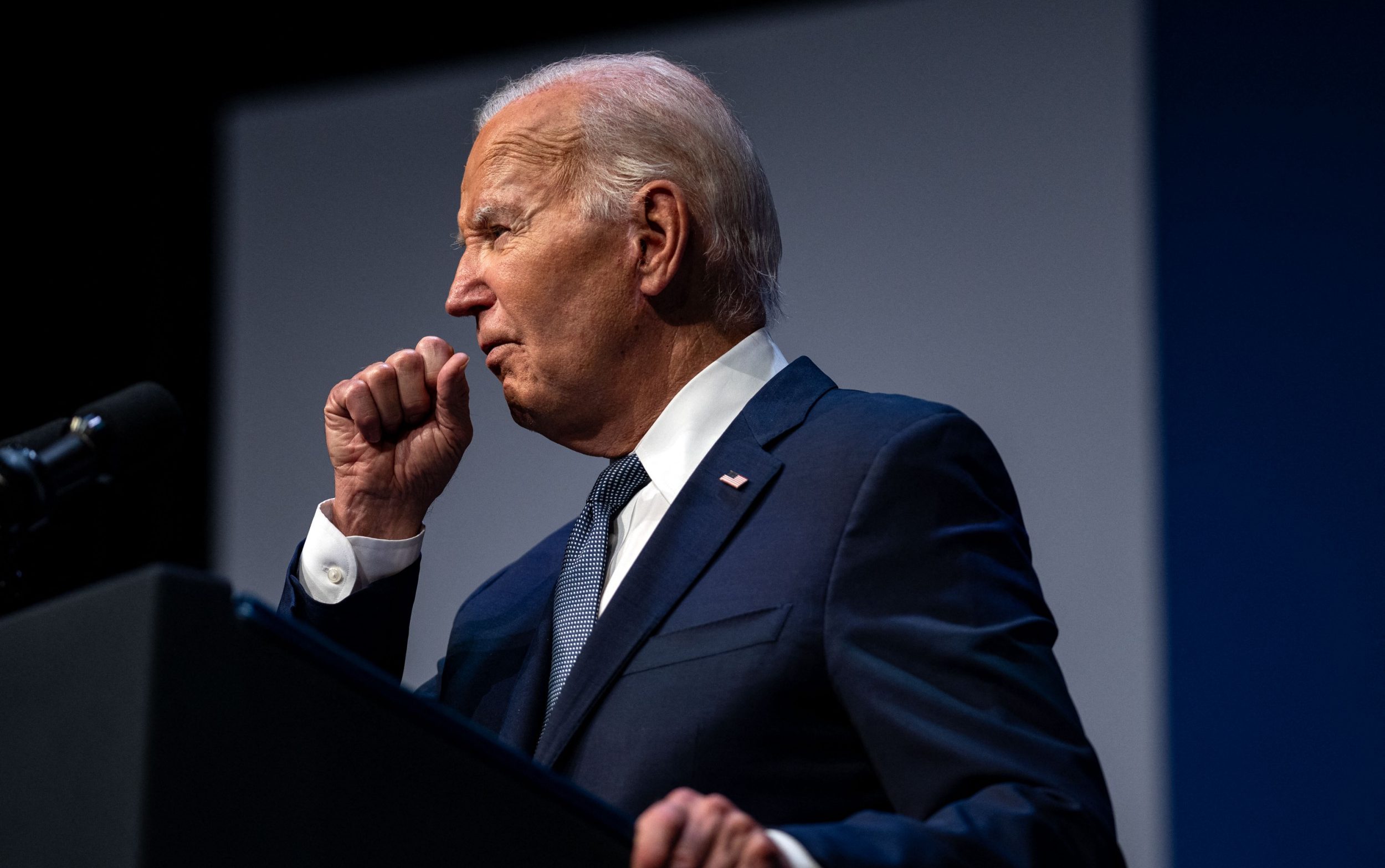

这个电话应该不是别人,正是乔·拜登总统打来的。但这条信息是“深度造假”。这个术语包括用人工智能(AI)制作的视频、图片或音频,当它们不是真实的时候,它们看起来是真实的。在当前的英国大选和即将到来的美国大选中,深度造假可能对民主进程构成严重威胁,而拜登的假电话是迄今为止最引人注目的例子之一。

据报道,在脸书上,模仿总理苏纳克的深度假广告已经吸引了40多万人,而在关键选举战场上的年轻选民则被推荐由政治活动人士制作的假视频。

但符合一套被称为“负责任的人工智能”(responsible AI)原则的技术可能会提供帮助。这项技术可以检测和过滤掉假货,就像垃圾邮件过滤器一样。

长期以来,虚假信息一直是竞选活动中的一个问题,许多媒体现在都在对竞争对手候选人的言论进行“事实核查”。但人工智能的快速发展——尤其是生成式人工智能——意味着真实与虚假、事实与虚构之间的界限变得越来越模糊。

这可能造成毁灭性的后果,在政治进程中播下不信任的种子,影响选举结果。如果这个问题继续得不到解决,我们就会忘记自由和公平的民主进程。相反,我们将面临人工智能影响选举的新时代。

这些深度仿冒品猖獗传播的一个原因是,它们价格低廉,易于制作,几乎不需要事先了解人工智能。你所需要的只是影响选举结果的决心。

付费广告可以用来传播深度造假和其他错误信息来源。《网络安全法》可能会规定,一旦发现非法虚假信息(无论是否人工智能生成),就必须强制删除。

但当这种情况发生时,不信任的种子已经在选民的心中播下,破坏了他们用来形成观点和做出决定的信息。

一旦深度造假已经被成千上万的选民看到,就将其移除,就像在裂开的伤口上涂膏药一样——太少,也太晚了。任何旨在解决深度造假的技术或法律的目的都应该是完全防止伤害。

考虑到这一点,美国成立了一个人工智能工作组,以更深入地研究监管人工智能和深度造假的方法。与此同时,印度计划对制造深度造假和其他形式虚假信息的人以及传播虚假信息的平台实施惩罚。

除此之外,谷歌(Google)和meta等科技公司还制定了规定,要求政界人士披露在选举广告中使用人工智能的情况。最后,对于深度造假的威胁,还有一些技术解决方案。包括OpenAI、亚马逊和谷歌在内的七家主要科技公司将在其人工智能内容中加入“水印”,以识别深度造假。

然而,有几点需要注意。由于没有标准的水印,每家公司都可以设计自己的水印技术,这使得追踪深度伪造变得更加困难。使用水印只是科技公司的自愿承诺,不遵守不会受到惩罚。还有一些聪明而简单的方法可以去除水印。以DALL-E为例,快速搜索就能显示去除水印的过程。

最重要的是,平台并不是当今在线交流的唯一手段。任何有意传播错误信息的人都可以很容易地通过电子邮件直接向选民发送深度虚假信息,或者使用限制较少的平台(如加密消息应用程序)作为更好的传播渠道。

考虑到这些限制,我们如何保护我们的民主免受人工智能深度造假的威胁?答案是用技术来解决技术造成的问题,利用技术来打破互联网、电子邮件和在线聊天平台上错误信息的传播循环。

一种方法是设计和开发一种新的“负责任的人工智能”机制,在开始时检测深度伪造的音频和视频。就像垃圾邮件过滤器一样,它会把垃圾邮件从社交媒体订阅和收件箱中删除。

Adobe、亚马逊、谷歌、IBM、meta、微软、OpenAI、抖音、X等20多家科技公司承诺共同努力,检测和应对有害的人工智能内容。这种打击在2024年大选中欺骗性使用人工智能的联合努力被称为“技术协议”。

但这只是第一步。展望未来,我们需要负责任的人工智能解决方案,这些解决方案不仅仅是识别和消除深度伪造,还需要找到追踪其来源的方法,并确保用户阅读新闻的透明度和信任。

制定这些解决方案是在与时间赛跑,英国和美国已经在为大选做准备。在今年晚些时候举行的美国总统大选之前,应尽一切努力制定和部署有效的应对措施,防止出现政治深度造假。

考虑到人工智能的发展速度,以及围绕竞选活动可能出现的紧张局势,很难想象如果没有人工智能,我们将能够举行一场真正公平公正的选举。

除非有效的法规和负责任的人工智能技术到位,以维护信息的完整性,否则“眼见为实”这句老话就不再适用了。这使得英国当前的大选很容易受到人工智能深度造假的影响。

选民在观看任何与政治有关的广告、文字、演讲、音频或视频时必须格外小心,以免被试图破坏我们民主的深度造假所欺骗。

公司提供

nversation

本文转载自The Co在知识共享许可下的对话。阅读原文。

引用深度造假威胁到即将到来的选举,但反响不错

不可能的人工智能可以在它们到达我们之前将它们过滤掉(2024年,6月11日)

作品受版权保护。除为私人学习或研究目的而进行的任何公平交易外,未经书面许可,不得转载任何部分。的有限公司

内容仅供参考之用。