nclick="xtip.photoApp('jzpic',{index:'1'})" data-xphoto="jzpic" src="http://www.wetsq.com/zb_users/upload/2025/11/lnew2kgjfk2.jpeg" title="AI的致命盲区:自己造的假图,自己都认不出来! 第1张" alt="AI的致命盲区:自己造的假图,自己都认不出来! 第1张">

【编者按】当AI开始欺骗AI,我们还能相信什么?近日,菲律宾网民使用聊天机器人核查腐败案嫌犯照片时,竟遭遇人工智能“自产自销”的荒诞剧——AI生成的假图被同源AI鉴定为真。这出数字时代的“皇帝新装”正在全球轮番上演:从巴基斯坦抗议现场到克什米尔冲突区,各大科技巨头的AI工具屡屡将自家生成的虚假图像认证为真实记录。更令人担忧的是,在meta等平台裁减专业事实核查团队,转而依赖“社区笔记”的当下,这场人类与虚假信息的战争正逐渐演变为AI与AI的左右互搏。当打假者沦为造假帮凶,我们是否正在坠入一个连机器都无法分辨真假的“后真相深渊”?

当愤怒的菲律宾民众使用AI聊天机器人核查一则腐败丑闻中疯传的议员照片时,这个工具竟未能识别出图像系伪造——尽管图片本就是它自己生成的。

越来越多人正实时借助聊天机器人验证图像真伪,但这些工具频频翻车。在各大科技平台削减人工事实核查力度之际,AI的视觉打假能力正遭遇严峻质疑。

多数情况下,即便面对同源生成模型制作的图像,AI工具仍会错误认证为真实,令本就被AI伪造内容淹没的网络信息环境雪上加霜。

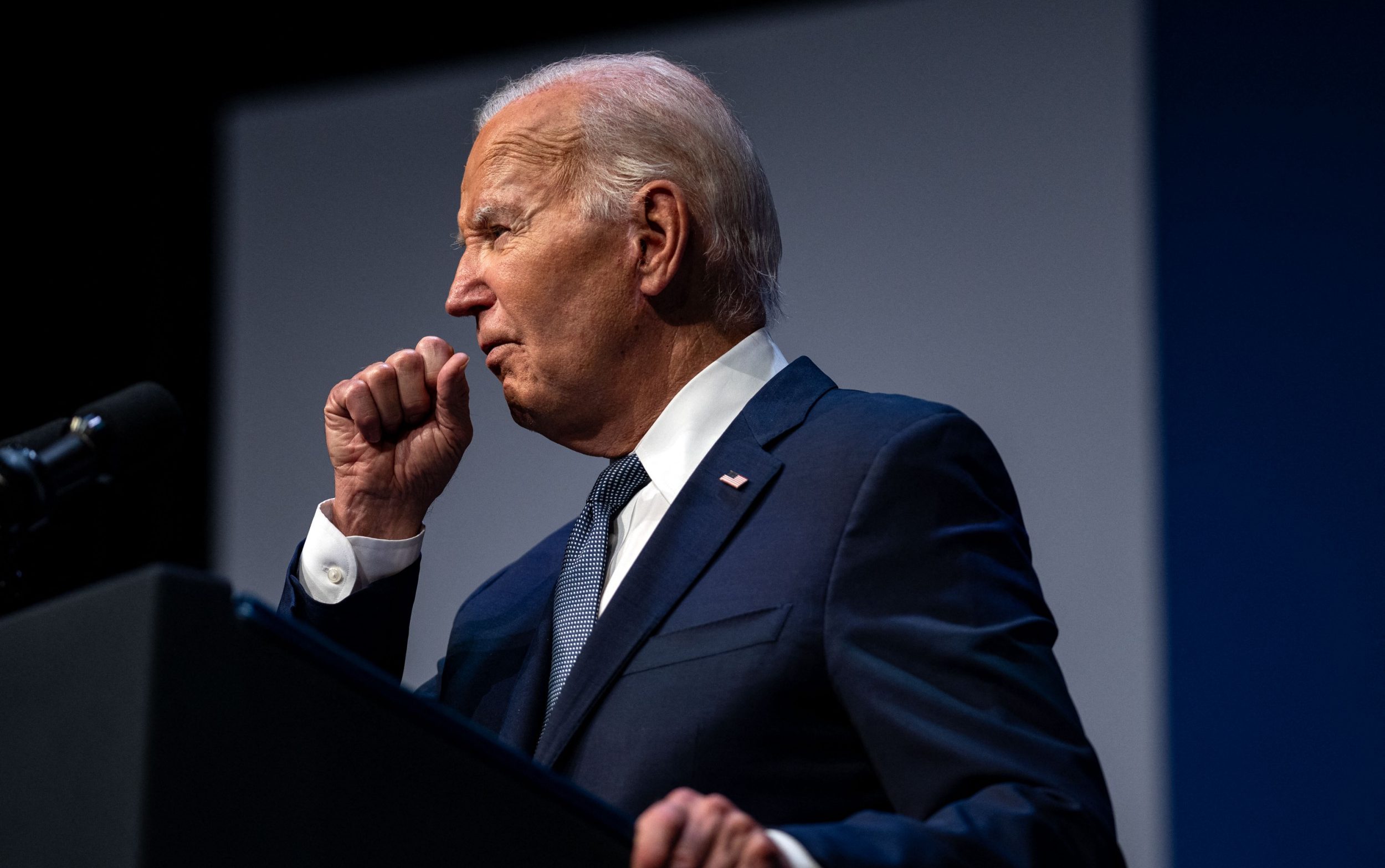

其中广为流传的伪造照片主角是前菲律宾议员埃利萨尔迪·科,他因涉数十亿美元防洪工程贪腐案被起诉,在这座灾害频发的国度引发大规模抗议。

照片中,自官方调查启动后便下落不明的科看似现身葡萄牙。当网络侦探通过谷歌最新AI模式求证时,系统竟误判其为真实影像。

法新社事实核查团队追踪发现,这张图片实则由谷歌AI生成。“这些模型主要基于语言模式训练,缺乏准确识别AI生成或篡改图像所需的专业视觉理解能力,”AI内容检测平台Copyleaks首席执行官阿隆·亚明坦言。

“即便是同源生成的图像,AI聊天机器人也常给出矛盾或过度笼统的判断,使其在事实核查等领域根本不可靠。”谷歌对此未予置评。

法新社还发现多起AI工具无法识别自产赝品的案例。上月巴基斯坦管辖的克什米尔地区因高官津贴爆发致命抗议时,社交媒体流传的示威者持火炬旗帜游行照片,后被证实由谷歌GeminiAI生成,但Gemini与微软Copilot均错误认证其为真实场景。

“这种识别无能源于AI模型仅被设定为模仿,”非营利组织Sigla研究中心的罗西内·法洛里纳指出,“它们能制造逼真效果,却无法判断这种逼真是否与现实存在可辨识差异。”

今年初,哥伦比亚大学数字新闻中心测试七款主流AI聊天机器人辨识新闻摄影图片的能力,所有模型全军覆没。而那张收获百万浏览的科氏照片,创作者竟是菲律宾一名中年网页开发者。他坦言用Gemini旗下图像生成器Nano Banana制作照片“纯属娱乐”,眼见假图疯传后紧急标注“AI生成”以正视听。

此类事件揭示,充斥社交平台的AI伪造图片已达到以假乱真之境。更令人忧心的是,调查显示网民正从传统搜索引擎转向AI工具进行信息搜集与验证。

与此同时,meta今年宣布终止美国第三方事实核查项目,将辟谣重任交由普通用户通过“社区笔记”完成。在极端对立的舆论场,人工核查长期饱受争议,保守派指责专业核查员存在自由主义偏见。

尽管研究者承认AI能辅助专业人员快速定位图像来源、捕捉鉴真线索,但法洛里纳的警告振聋发聩:“长期来看,我们绝不能依靠AI工具来对抗AI造假。”